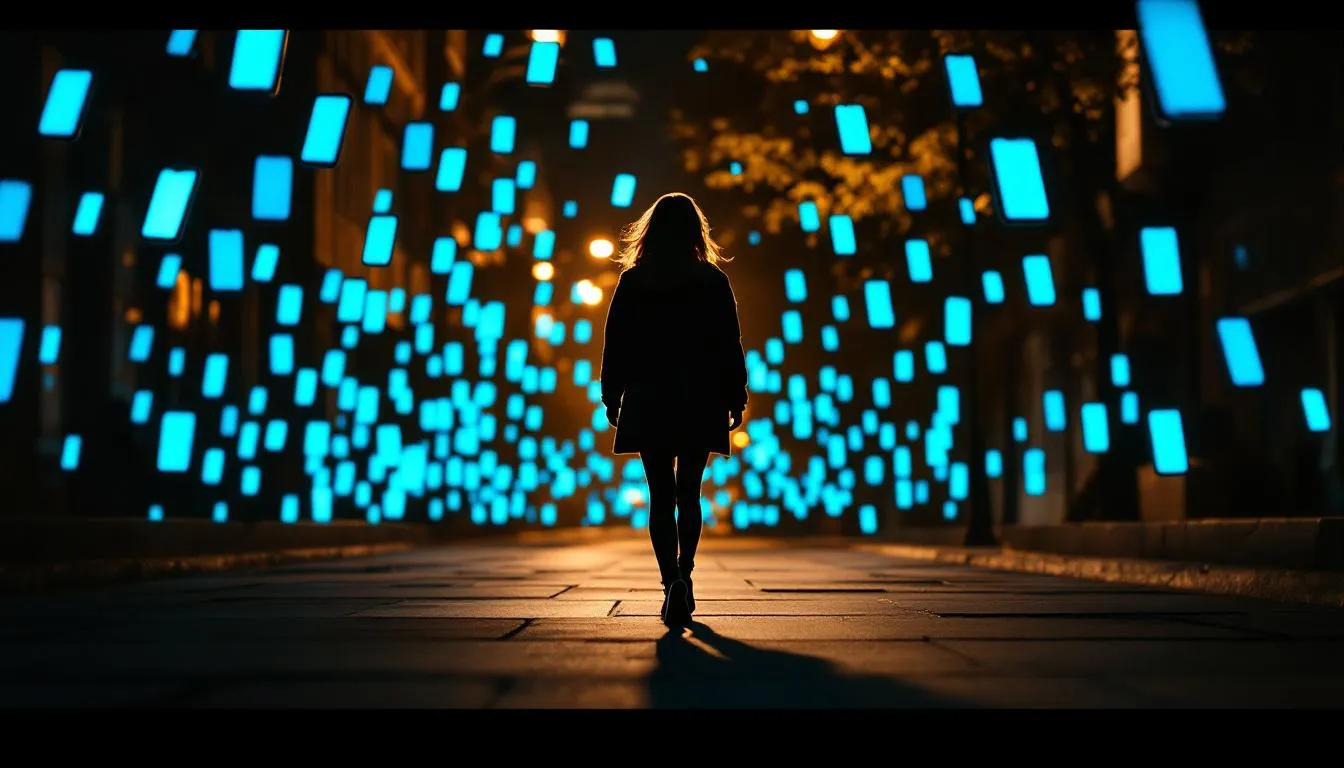

Une influenceuse TikTok poste une vidéo de danse. Quelques heures plus tard, son visage apparaît dans des groupes Telegram privés, collé sur un corps nu généré par intelligence artificielle. Des inconnus l’achètent pour 5 euros l’abonnement mensuel. Elle ne le saura peut-être jamais. C’est ce que documente une enquête de l’organisation AI Forensics publiée cette semaine, qui décrit Telegram comme un marché structuré, rentable et quasi invisible.

2,8 millions de messages pour cartographier une filière

Les chercheuses d’AI Forensics ont analysé 2,8 millions de messages échangés dans 16 groupes italiens et espagnols. Elles y ont trouvé 24 671 utilisateurs actifs, certains canaux comptant jusqu’à 27 000 membres. Le mot « bot » y apparaît 16 232 fois, reflet d’une infrastructure entièrement automatisée.

Le fonctionnement est rodé. Des bots spécialisés, les nudify bots, reçoivent une photo d’une personne réelle et la restituent modifiée, nue, en quelques secondes. D’autres bots gèrent les archives : des collections d’images intimes non consenties revendues 20 à 50 euros en accès unique, ou dès 5 euros par mois en abonnement. Les affiliés qui recrutent de nouveaux clients touchent jusqu’à 40 % de commission sur chaque vente.

Parmi les liens partagés dans ces groupes, 49,71 % redirigent vers des générateurs de « petites amies IA » et 19,14 % pointent vers des bots de nudification. Les paiements transitent par PayPal, des cryptomonnaies, et Bizum, service bancaire mobile très répandu en Espagne.

TikTok au centre de la cible

AI Forensics a identifié une pratique spécifique : la production en série de deepfakes ciblant des créatrices TikTok connues, rassemblées sous le hashtag #PornoTok dans ces canaux privés. Vidéo retouchée, voix synthétique, image statique : tout y passe. La notoriété de ces femmes est transformée en marchandise sans leur accord.

Ce n’est pas un phénomène isolé à l’Italie et à l’Espagne. Selon un rapport du Guardian publié en janvier 2026, au moins 150 canaux Telegram du même type ont été répertoriés dans des dizaines de pays, du Royaume-Uni au Brésil, de la Chine à l’Inde. Des millions d’utilisateurs y ont interagi au cours des douze derniers mois. 72 % du contenu partagé dans les groupes espagnols analysés se retrouve également dans les groupes italiens, signe d’une circulation transfrontalière organisée. Une même collection peut donc toucher des victimes dans plusieurs pays en quelques heures, rendant les recours judiciaires particulièrement complexes.

Une étude académique publiée à la conférence ICWSM 2026, disponible sur arXiv, confirme l’ampleur du phénomène sur la plateforme : après avoir analysé 492 millions de messages échangés par 32 000 bots actifs, ses auteurs constatent que ces programmes facilitent « des arnaques financières, la revente de données volées, et le partage d’images non consenties ». Les bots de nudification ne constituent pas une exception : ils s’inscrivent dans un écosystème de bots malveillants bien plus vaste.

292 millions de revenus, et une question gênante

Telegram a encaissé 292 millions de dollars de revenus d’abonnements en 2024. AI Forensics souligne que ces abonnements premium offrent aux utilisateurs un accès élargi aux fonctionnalités des bots payants. La plateforme tire donc un revenu indirect de l’infrastructure qui rend cette filière possible.

La responsabilité de Telegram est débattue depuis plusieurs années. L’arrestation de son fondateur Pavel Durov en France en août 2024 avait mis le sujet sous les projecteurs : les autorités lui reprochaient de ne pas coopérer avec les enquêtes sur des contenus criminels hébergés sur la plateforme. Depuis, Telegram a publiquement annoncé un renforcement de sa modération. Mais les chiffres publiés cette semaine suggèrent que les réseaux d’abus fonctionnent toujours.

La plateforme reste dans une zone grise réglementaire. Avec 900 millions d’utilisateurs déclarés, elle dépasse les seuils qui lui imposeraient d’être classée « très grande plateforme en ligne » au sens du Règlement européen sur les services numériques (DSA). Ce statut obligerait Telegram à des audits de risques, une modération contraignante, et une coopération renforcée avec les autorités. Pourtant, Telegram n’a pas encore été formellement désignée par la Commission européenne.

Ce que l’Europe peut faire, et tarde à faire

Les chercheuses formulent trois demandes précises en direction de Bruxelles. Premièrement, activer la procédure de désignation de Telegram comme très grande plateforme sous le DSA. Deuxièmement, interdire dans l’Union européenne les outils de nudification par IA, qui restent dans un vide juridique dans la plupart des pays membres. La France a bien renforcé ses textes en 2024 avec des dispositions criminalisant la diffusion de deepfakes non consentis, mais la création de ces images via des outils accessibles en quelques clics reste difficile à poursuivre en amont. Troisièmement, imposer via le Règlement sur l’IA des garde-fous techniques obligatoires dans tout système capable de générer des contenus intimes synthétiques à partir d’une photo réelle.

Ces outils ne se cachent pas. La plupart des bots de nudification sont accessibles directement depuis l’interface de Telegram, référencés dans des annuaires publics, et affichent des centaines de milliers d’utilisateurs. Leur popularité repose sur une faiblesse structurelle bien connue : les technologies de génération d’image sont légitimes par elles-mêmes, utilisées chaque jour pour des usages créatifs ou professionnels. C’est leur application à des photos de personnes réelles, sans leur consentement, qui constitue l’abus. Et cette distinction, les plateformes préfèrent ne pas l’arbitrer.

OpenAI entre aussi dans le débat

Le même jour où AI Forensics publiait son rapport, OpenAI a rendu public un plan de sécurité centré sur la lutte contre l’exploitation sexuelle d’enfants liée à l’IA. L’entreprise y décrit ses propres outils de détection et ses engagements de coopération avec des organisations spécialisées, reconnaissant ainsi que les modèles génératifs peuvent alimenter ces abus. C’est la première fois qu’OpenAI consacre un document complet à cette seule thématique.

La convergence de ces deux publications en une journée traduit une pression croissante sur l’ensemble du secteur. Les régulateurs européens, qui planchent sur les modalités d’application du volet « IA générative » du règlement IA d’ici à la fin 2026, disposent d’un outil peu utilisé : la procédure d’urgence du DSA, qui permet d’imposer des restrictions temporaires à une plateforme sans attendre sa désignation formelle. Un rapport d’étape de la Commission sur l’application du DSA aux plateformes non encore désignées est attendu pour le premier trimestre 2027.