Un milliard de dollars pour un labo qui n’a pas encore produit une seule ligne de code public. AMI Labs, fondé à Paris par le prix Turing Yann LeCun, vient de boucler le plus gros tour de seed jamais réalisé en Europe. Sa promesse : prouver que toute l’industrie de l’IA, de ChatGPT à Gemini, s’est trompée de chemin.

890 millions d’euros en quatre mois d’existence

LeCun cherchait 500 millions. Il en a obtenu 890, soit 1,03 milliard de dollars, pour une valorisation de 3,5 milliards avant même d’avoir un produit. Le tour a été mené par Cathay Innovation, Greycroft, Hiro Capital et HV Capital, avec une participation de Bezos Expeditions, le fonds personnel de Jeff Bezos. Nvidia, Toyota, Samsung et le fonds souverain singapourien Temasek ont aussi signé. Côté individus, Eric Schmidt, Mark Cuban et Xavier Niel figurent au tableau.

C’est la plus grosse levée en amorçage de l’histoire européenne, et l’une des plus importantes tous stades confondus pour une startup IA sur le continent. Le précédent record en seed tournait autour de 200 millions. AMI l’a pulvérisé par cinq.

L’homme qui pense que ChatGPT est une impasse

Yann LeCun n’est pas un inconnu. Ce Franco-Américain de 65 ans a reçu le prix Turing en 2018 pour ses travaux sur les réseaux de neurones convolutifs, la brique technologique derrière la reconnaissance d’images. Il a passé douze ans chez Meta comme responsable de la recherche en IA. Il en est parti en novembre 2025 avec une conviction tranchante : les grands modèles de langage (LLM) comme GPT ou Claude sont, selon ses mots, « une illusion statistique, impressionnante mais pas intelligente ».

Sa thèse est simple. Les LLM prédisent le mot suivant dans une phrase. Ils manipulent du langage avec une fluidité bluffante, mais ne comprennent rien au monde physique. Un enfant de deux ans sait qu’un objet lâché tombe. Aucun LLM ne le sait vraiment, il ne fait que reproduire des phrases qui le décrivent. Pour LeCun, c’est une limite architecturale, pas un problème qu’on résout en ajoutant plus de données.

Des « modèles du monde » inspirés du cerveau animal

AMI Labs construit ce que LeCun appelle des « world models », des modèles qui apprennent comment le monde fonctionne, pas seulement comment le langage fonctionne. L’architecture qui porte ce projet s’appelle JEPA, Joint Embedding Predictive Architecture, proposée par LeCun en 2022.

Le principe : au lieu de prédire chaque pixel d’une vidéo ou chaque mot d’un texte, JEPA apprend des représentations abstraites de la réalité. Le système ignore les détails imprévisibles (un reflet, un bruit de fond) pour se concentrer sur la structure profonde des événements. C’est la façon dont un cerveau humain ou animal comprend son environnement, pas en analysant chaque photon, mais en construisant un modèle interne du monde.

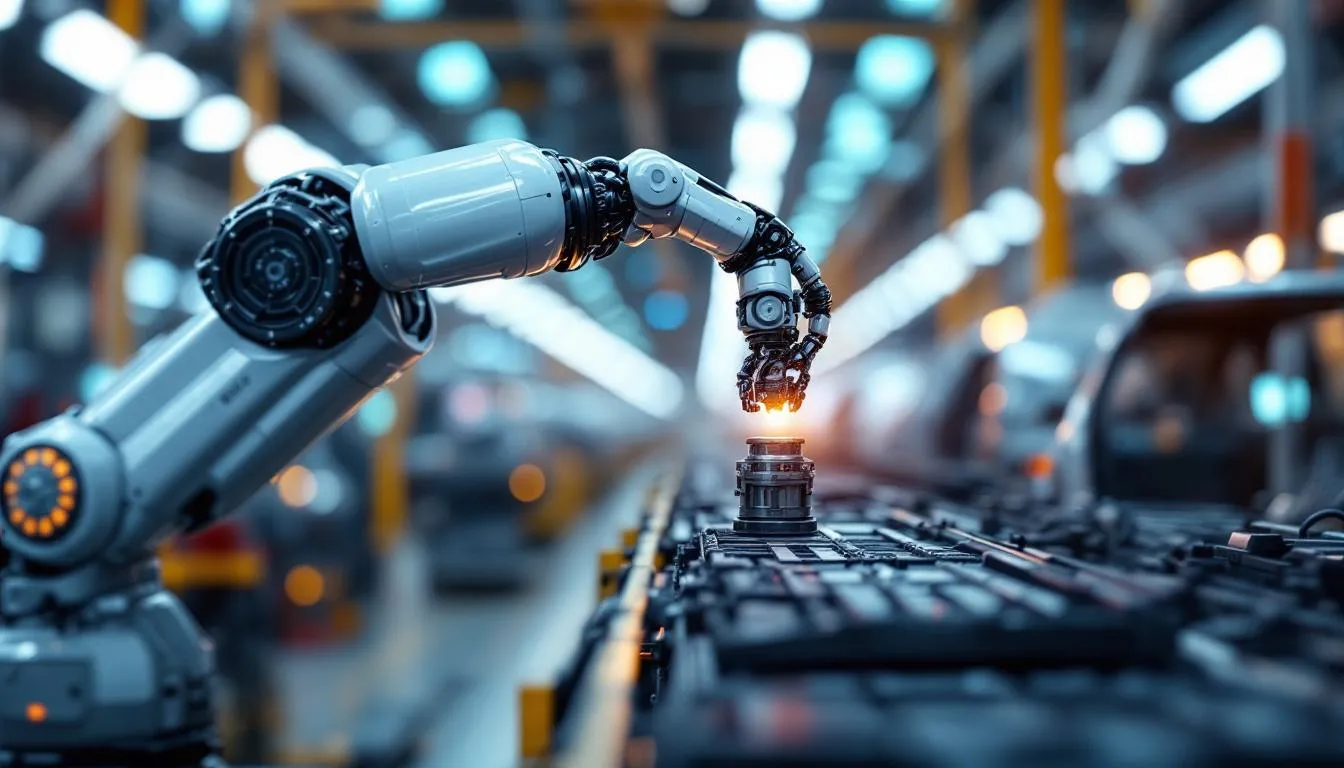

Les applications visées sont les domaines où les LLM échouent le plus : robotique industrielle, conduite autonome, diagnostic médical par imagerie, manipulation d’objets physiques. Partout où il ne suffit pas de bien parler, mais où il faut comprendre la physique.

Une équipe taillée pour le combat

LeCun occupe le poste de président exécutif. À ses côtés, Alexandre LeBrun, fondateur de la startup Nabla, prend la direction générale. Laurent Solly, ancien vice-président de Meta pour l’Europe, gère les opérations. Le directeur scientifique est Saining Xie, et Pascale Fung dirige la recherche et l’innovation. La majorité de l’équipe vient directement de la division recherche IA de Meta.

Le QG est à Paris, avec des bureaux à New York, Montréal et Singapour. Le choix de Paris n’est pas anodin : LeCun positionne AMI comme l’alternative européenne à la domination américaine et chinoise en IA. Avec Xavier Niel parmi les investisseurs et un ancrage dans l’écosystème French Tech, le signal est clair.

Le pari qui divise la communauté IA

La thèse de LeCun ne fait pas l’unanimité. Chez OpenAI, la stratégie consiste à pousser les LLM toujours plus loin, en ajoutant des capacités de raisonnement, de mémoire et d’exécution d’actions complexes. GPT-5.4, lancé début 2026, gère un million de tokens de contexte et exécute des workflows autonomes. Chez Google, Gemini suit la même trajectoire. Les deux camps estiment que les limites des LLM sont surmontables par l’ingénierie, pas par un changement d’architecture.

LeCun rétorque que l’ingénierie ne corrige pas un défaut de conception. Un LLM peut décrire comment une balle rebondit. Un world model peut prédire où elle atterrira. Dans un entrepôt robotisé ou un bloc opératoire, la différence entre décrire et comprendre sépare un outil utile d’un système dangereux.

Pas de produit avant trois ans, et c’est voulu

AMI ne promet rien de concret à court terme. La première année est entièrement dédiée à la recherche. Les discussions avec des partenaires industriels ne commenceront pas avant un à deux ans. Des systèmes déployables à grande échelle ne sont pas attendus avant trois à cinq ans.

C’est un pari d’une patience rare dans un secteur où OpenAI génère déjà 25 milliards de dollars de revenus annuels et où Anthropic s’approche des 19 milliards. Pendant que ces deux rivaux engrangent du chiffre d’affaires, AMI brûle du cash en recherche pure, sans la moindre rentrée en vue.

Le nom du labo, AMI, se prononce comme le mot français « ami ». LeCun assume le clin d’œil. Si ses world models fonctionnent, la France aura engendré une alternative crédible aux géants de San Francisco et Pékin. S’ils échouent, un milliard d’euros aura financé la plus ambitieuse expérience de pensée de l’IA européenne. Les premiers résultats tangibles sont attendus courant 2028.